编辑:LRS

注意力机制这么好用,怎么不把它塞到卷积网络里?最近MetaAI的研究人员提出了一个基于注意力的池化层,仅仅把平均池化层替换掉,就能获得+0.3%的性能提升!

VisualTransformer作为计算机视觉领域的新兴霸主,已经在各个研究任务中逐渐替换掉了卷积神经网络CNN。

ViT与CNN之间存在着许多不同点,例如ViT的输入是imagepatch,而非像素;分类任务中,ViT是通过对类标记进行决策等等。

classtoken实际上是ViT论文原作者提出,用于整合模型输入信息的token。classtoken与每个patch进行信息交互后,模型就能了解到具体的分类信息。

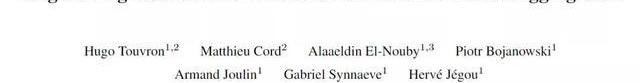

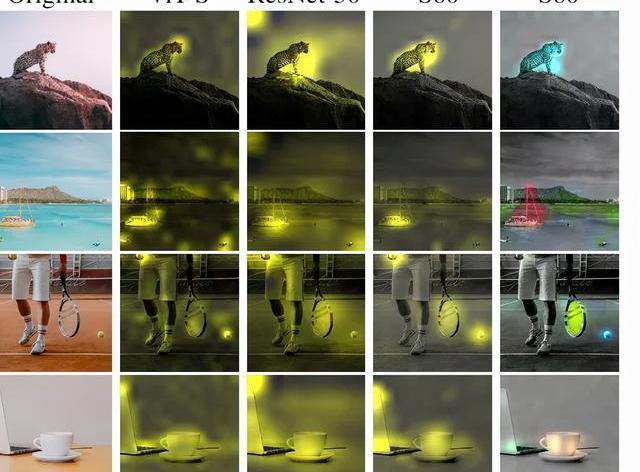

并且在自注意力机制中,最后一层中的softmax可以作为注意力图,根据classtoken和不同patch之间的交互程度,就能够了解哪些patch对最终分类结果有影响及具体程度,也增加了模型可解释性。

但这种可解释性目前仍然是很弱的,因为patch和最后一层的softmax之间还隔着很多层和很多个header,信息之间的不断融合后,很难搞清楚最后一层softmax是否真的可以解释分类。

CoinShares:上周数字资产投资产品净流入1.25亿美元:金色财经报道,据CoinShares报告显示,上周数字资产投资产品净流入1.25亿美元,过去两周净流入达到3.34亿美元,占管理资产总额 (AuM) 的近1%。比特币净流入为1.23亿美元,过去两周的流入量占所有数字资产流量的98%。以太坊投资产品流入 270 万美元,做空比特币投资产品资金流出90万美元,已连续第10周流出。[2023/7/3 22:15:37]

所以如果ViT和CNN一样有视觉属性就好了!

最近MetaAI就提出了一个新模型,用attentionmap来增强卷积神经网络,说简单点,其实就是用了一个基于注意力的层来取代常用的平均池化层。

仔细一想,池化层和attention好像确实很配啊,都是对输入信息的加权平均进行整合。加入了注意力机制以后的池化层,可以明确地显示出不同patch所占的权重。

Sui基金会发布代币释放时间表,预计将于2030年4月释放完毕:6月29日消息,据官方消息,Sui基金会发布了代币释放详细计划。Sui主网于2023年5月3日上线。SUI代币长期流通供应量为100亿枚。在主网启动时,大约有5%的代币在流通,其余的代币将按照拟议的时间表释放。预计所有代币将于2030年4月释放完毕。Sui基金会表示,时间表可能会根据需要进行更改,以保持Sui网络的健康。

据此前消息,Sui基金会表示,已按计划逐步增加SUI代币供应以增加生态系统流动性。Sui基金会没有在币安或其它平台出售“锁定”和”非流通”质押SUI所产生的奖励或任何其他代币,所有内部代币分配仍受制于锁定期和其他转让限制。[2023/6/29 22:07:15]

并且与经典ViT相比,每个patch都会获得一个单一的权重,无需考虑多层和多头的影响,这样就可以用一个简单的方法达到对注意力可视化的目的了。

Sui生态钱包Ethos完成420万美元融资,Mysten Labs参投:1月26日消息,Sui 生态钱包 Ethos 完成 420 万美元种子轮融资,本轮融资由 Gumi Cryptos Capital 和 Boldstart Ventures 领投,Tribe Capital、Matrix Port 和 AllianceDAO 以及 Sui 网络开发方 Mysten Labs 参投。[2023/1/27 11:31:27]

在分类任务中更神奇,如果对每个类别使用不同颜色进行单独标记的话,就会发现分类任务也能识别出图片中的不同物体。

基于Attention的池化层

文章中新提出的模型叫做PatchConvNet,核心组件就是可学习的、基于attention的池化层。

欧盟的DLT试点将允许市场运营商在新的加密法规出台之前交易稳定币:金色财经报道,欧盟专员Rok Zvelc表示,欧盟的一个试点项目将允许市场参与者在加密货币法律框架至少两年后实施之前使用稳定币进行交易和结算。该计划被称为DLT试点制度,允许传统金融和数字金融的参与者在受监管的环境中试验使用通证化证券。

所谓的电子货币代币,是单一法定货币计价的稳定币,在欧盟全面的加密资产市场监管中被定义为MiCA。这些规则最早要到2024年才能应用,但试点参与者已经能够在DLT试点内的交易和结算中开始使用电子货币代币。(the block)[2022/10/28 11:50:35]

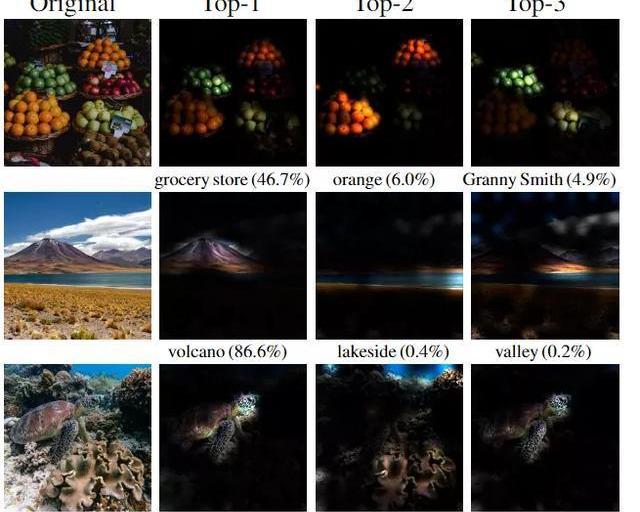

模型架构的主干是一个卷积网络,相当于是一个轻量级的预处理操作,它的作用就是把图像像素进行分割,并映射为一组向量,和ViT中patchextraction操作对应。

最近也有研究表明,采用卷积的预处理能让模型的性能更加稳定。

泰格豪雅为旗下部分智能手表推出NFT展示功能:6月16日消息,时尚巨头LVMH旗下瑞士豪华手表制造商泰格豪雅(Tag Heuer)周三上午宣布了一项新功能,将允许客户在某些型号的智能手表表盘上展示NFT。

泰格豪雅与Ledger合作,面向Tag Heuer Connected Calibre E4智能手表用户推出了此功能,该款手表也将兼容MetaMask。用户可以通过苹果App Store或谷歌Play Store免费获得这一更新。

该公司表示,他们与Bored Ape Yacht Club、CryptoPunks、Clone-X和World of Women等蓝筹NFT项目合作实现了这一想法。(The Block)[2022/6/16 4:31:08]

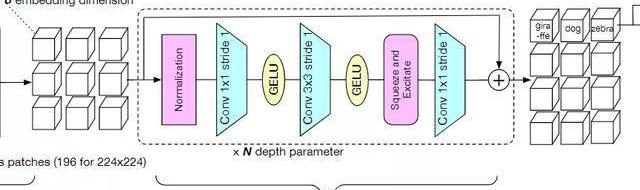

模型的第二部分column,包含了整个模型中的大部分层、参数和计算量,它由N个堆叠的残差卷积块组成。每个块由一个归一化、1*1卷积,3*3卷积用来做空间处理,一个squeeze-and-excitation层用于混合通道特征,最后在残差连接前加入一个1*1的卷积。

研究人员对模型块的选择也提出了一些建议,例如在batchsize够大的情况下,BatchNorm往往效果比LayerNorm更好。但训练大模型或者高分辨率的图像输入时,由于batchsize更小,所以BatchNorm在这种情况下就不太实用了。

下一个模块就是基于注意力的池化层了。

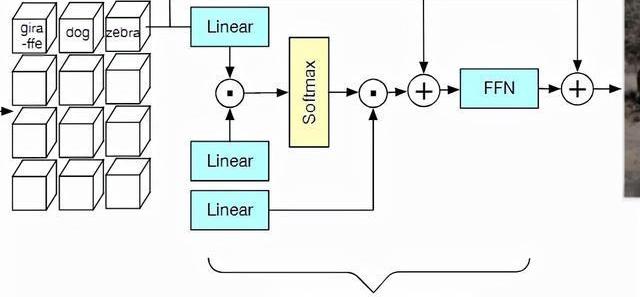

在主干模型的输出端,预处理后的向量通过类似Transformer的交叉注意力层的方式进行融合。

注意力层中的每个权重值取决于预测patch与可训练向量之间的相似度,结果和经典ViT中的classtoken类似。

然后将产生的d维向量添加到CLS向量中,并经过一个前馈网络处理。

与之前提出的class-attentiondecoder不同之处在于,研究人员仅仅只用一个block和一个head,大幅度简化了计算量,也能够避免多个block和head之间互相影响,从而导致注意力权重失真。

因此,classtoken和预处理patch之间的通信只发生在一个softmax中,直接反映了池化操作者如何对每个patch进行加权。

也可以通过将CLS向量替换为k×d矩阵来对每个类别的attentionmap进行归一化处理,这样就可以看出每个块和每个类别之间的关联程度。

但这种设计也会增加内存的峰值使用量,并且会使网络的优化更加复杂。通常只在微调优化的阶段以一个小的学习率和小batchsize来规避这类问题。

实验结果

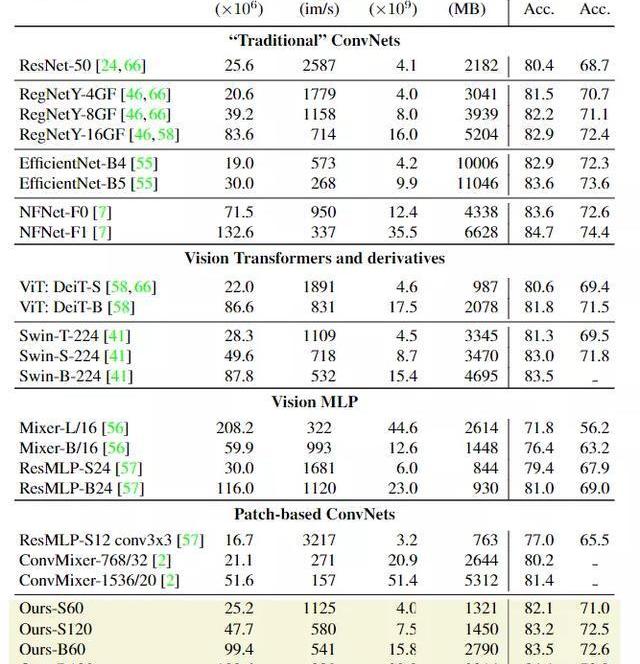

在图像分类任务上,研究人员首先将模型与ImageNet1k和ImageNet-v2上的其他模型从参数量,FLOPS,峰值内存用量和256张图像batchsize下的模型推理吞吐量上进行对比。

实验结果肯定是好的,可以看到PatchConvNet的简单柱状结构相比其他模型更加简便和易于扩展。对于高分辨率图像来说,不同模型可能会针对FLOPs和准确率进行不同的平衡,更大的模型肯定会取得更高的准确率,相应的吞吐量就会低一些。

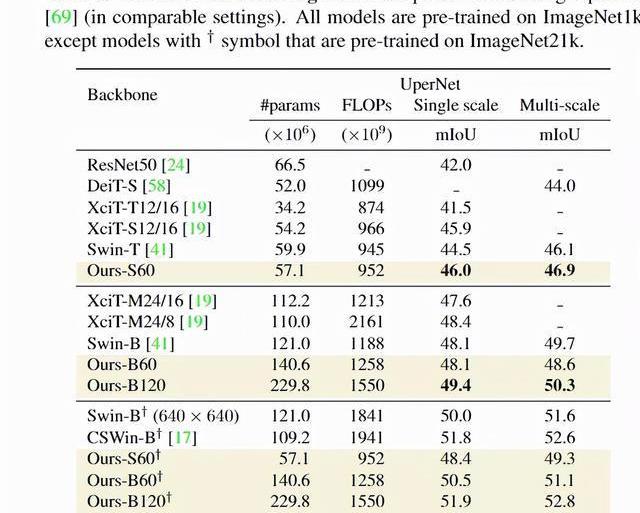

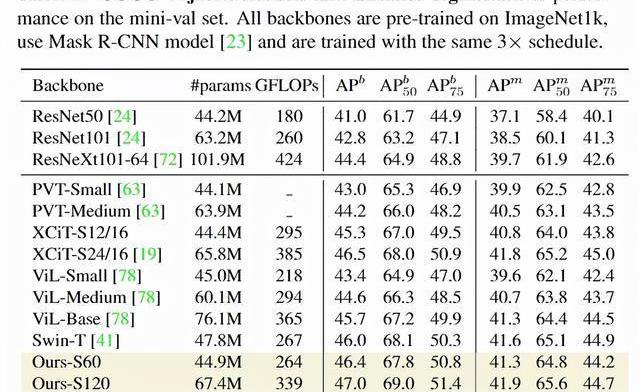

在语义分割任务上,研究人员通过ADE20k数据集上的语义分割实验来评估模型,数据集中包括2万张训练图像和5千张验证图像,标签超过150个类别。由于PatchConvNet模型不是金字塔式的,所以模型只是用模型的最后一层输出和UpperNet的多层次网络输出,能够简化模型参数。研究结果显示,虽然PatchConvNet的结构更简单,但与最先进的Swin架构性能仍处于同一水平,并且在FLOPs-MIoU权衡方面优于XCiT。

在检测和实例分割上,研究人员在COCO数据集上对模型进行评估,实验结果显示PatchConvNet相比其他sota架构来说,能够在FLOPs和AP之间进行很好的权衡。

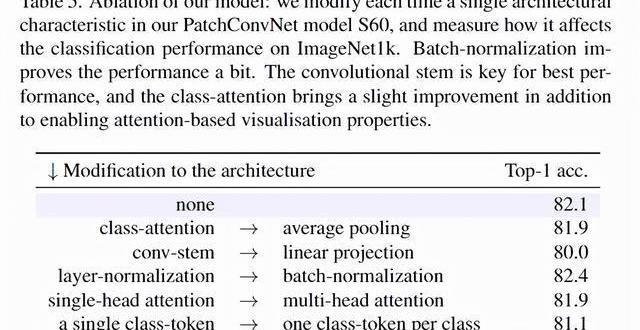

在消融实验中,为了验证架构问题,研究人员使用不同的架构对比了Transformer中的classattention和卷积神经网络的平均池化操作,还对比了卷积主干和线性投影之间的性能差别等等。实验结果可以看到卷积主干是模型取得最佳性能的关键,class-attention几乎没有带来额外的性能提升。

另一个重要的消融实验时attention-basedpooling和ConvNets之间的对比,研究人员惊奇地发现可学习的聚合函数甚至可以提高一个ResNet魔改后模型的性能。

通过把attention添加到ResNet50中,直接在Imagenet1k上获得了80.1%的最高准确率,比使用平均池化层的baseline模型提高了+0.3%的性能,并且attention-based只稍微增加了模型的FLOPs数量,从4.1B提升到4.6B。

参考资料:

https://arxiv.org/abs/2112.13692

北京梅赛德斯-奔驰销售服务有限公司高级执行副总裁张焱正是在“新豪华”与“心豪华”的引领下,数字化转型成为持续发展的关键支点,而客户体验始终是前进的惟一方向.

1900/1/1 0:00:00记者|司林威 持续低迷的加密货币市场迎来一次反弹。北京时间2月5日凌晨,行情数据显示,比特币价格快速上升,24小时内大涨超11%,最新报价为41280美元,最高反弹至41900美元,重新站上40.

1900/1/1 0:00:0021世纪经济报道记者陈植上海报道在数字人民币APP上架各大应用商店后,其应用场景迅速扩容。21世纪经济报道记者获悉,深圳、苏州、雄安、成都、上海、海南、长沙、西安、青岛、大连、冬奥会场景等11个.

1900/1/1 0:00:00关于“btc是什么”有以下解释:btc是“比特币”(bitcoin)的英文简称,是一种数字货币,也是一种可用于在接受该货币的地方交换商品和服务的虚拟令牌。 比特币是一种P2P格式的数字货币.

1900/1/1 0:00:00AwindpowerplantinDingxi,Gansuprovince.>Chinafulfillsgreengoalsin20212021年生态环境质量持续改善LiuYoubin.

1900/1/1 0:00:00摘要:现代汽车周一在东京的一次简报中表示,公司将于今年开始在日本销售Ioniq5电动车和燃料电池车Nexo;特斯拉部分车辆被曝减配,特斯拉中国官方客服表示.

1900/1/1 0:00:00